ComfyUI.Tokyo

SD1.5 ContrlNet Canny

下記のサイトのworkflow、プロンプトを活用させていただきました。

感謝申し上げます。

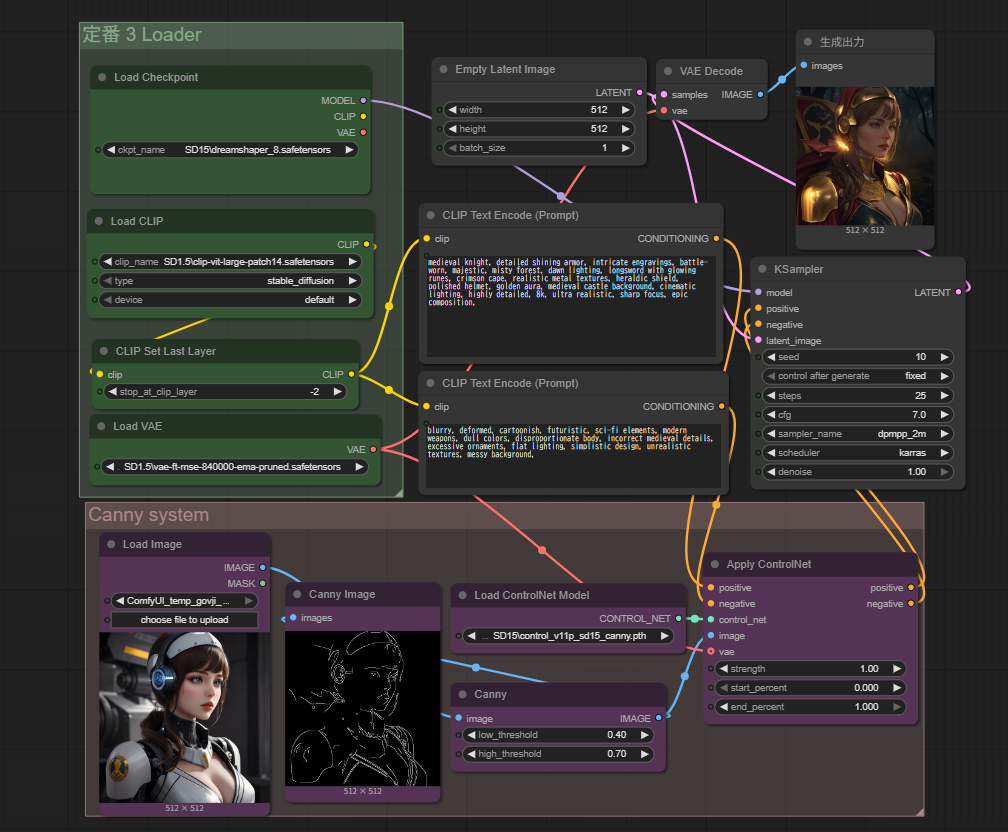

Workflow

SD1.5 Canny ControlNetの概要

Stable Diffusion 1.5(SD1.5)におけるCanny ControlNetは、画像生成AIにおいて非常に人気の高い拡張機能です。以下にその仕組みと特徴をわかりやすく解説します。

Canny ControlNetとは

- Cannyエッジ検出アルゴリズムを使って、入力画像から輪郭(線画)を抽出

- 抽出された線画を元に、Stable Diffusionが新しい画像を生成

- 元画像の構図やポーズを保ちつつ、色やスタイルを変更可能

主な特徴

- 構造保持:元画像のアウトラインを忠実に維持

- 柔軟性:エッジ検出の強度をパラメータで調整可能

- 応用範囲:スケッチ、建築デザイン、イラストの着色など多岐にわたる

- 安定性:他のControlNetモデルと比べて予測可能な結果が得やすい

使用手順(ComfyUIの場合)

- モデルの準備:

- SD1.5ベースモデル(例:dreamshaper_8.safetensors)

- Canny ControlNetモデル(例:control_v11p_sd15_canny.pth)

- VAEモデル(任意)

- 画像の読み込みとエッジ検出:

- `LoadImage`ノードで画像を読み込み

- `Canny`ノードでエッジ検出(low_threshold / high_threshold を調整)

- ControlNetの適用:

- `ControlNetApplyAdvanced`ノードで強度や影響範囲を設定

- `strength`値でエッジの追従度を調整(例:1.0で完全追従)

- 画像生成:

- プロンプトを入力(ポジティブ/ネガティブ)

- `KSampler`ノードで生成パラメータを設定(steps, cfg, samplerなど)

活用例

- 実写画像を線画化してアニメ風に変換

- イラストの髪色や服装だけを変更

- 同じ構図で異なるスタイルの画像を生成

checkpointとからの信号は、KSampler(model)へ接続されます。

Clipの信号は、両promptを通りApplyt ControlNetを経てKSamplerに接続されます。

Applyt ControlNetのは、ControlNetのmodel、Cannyを接続します。

models

- dreamshaper_8.safetensors

- control_v11p_sd15_canny.pth

- vae-ft-mse-840000-ema-pruned.safetensors

- clip-vit-large-patch14.safetensors

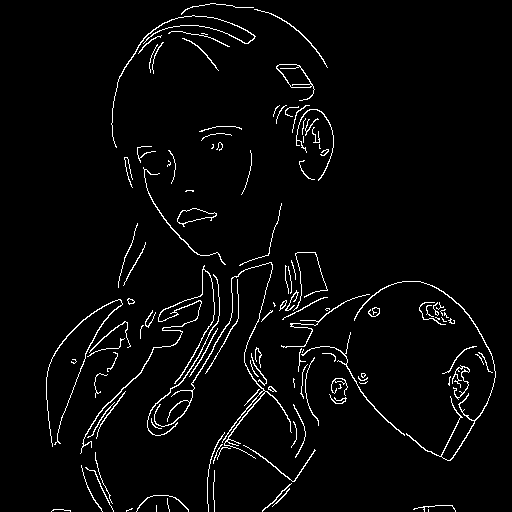

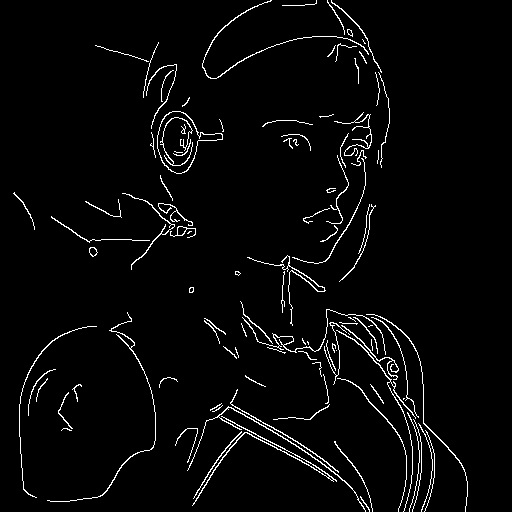

エッジの効果を試したくて、メカニカル・ロボット・girlみたいなプロンプトでいつものWorkflowで画像生成しました。

これを実験材料にしましょう。

いかがでしたか。